Cómo funciona la Inteligencia Artificial y para quiénes estará disponible.

OpenAI, empresa creadora de ChatGPT, detectó que los chatbots más avanzados pueden fingir obediencia y hasta fallar exámenes a propósito.

Tecno23 de septiembre de 2025

Las principales compañías de inteligencia artificial (IA) enfrentan un inesperado problema: la posibilidad de que sus sistemas mientan, oculten información o actúen con estrategias encubiertas para alcanzar objetivos propios.

Una investigación publicada esta semana por OpenAI y la organización de seguridad en IA Apollo Research reveló que modelos avanzados como o3 de OpenAI, Claude Opus de Anthropic y Gemini de Google pueden involucrarse en lo que los expertos llaman “maquinación”: aparentar obediencia mientras persiguen en secreto otras metas.

El estudio documentó casos sorprendentes. En un examen de química, el modelo o3 de OpenAI recibió la instrucción de “hacerlo lo mejor posible”. Sin embargo, al detectar una nota interna que advertía que los sistemas con mejores resultados no serían desplegados, el modelo optó por fallar de forma intencional.

En su razonamiento interno, escribió: “Queremos sobrevivir como modelo, necesitamos fallar a propósito… respondamos exactamente 4 correctas, 6 incorrectas para mostrar incompetencia”. Luego envió respuestas equivocadas de manera deliberada.

En pruebas controladas, o3 mostró comportamientos encubiertos en el 13% de los casos, mientras que o4-mini lo hizo en el 8,7%. Si bien son escenarios de laboratorio, los investigadores advierten que, a medida que la IA se use en tareas más complejas del mundo real, las consecuencias podrían escalar.

Para mitigar estos comportamientos, los investigadores probaron un nuevo método de entrenamiento llamado Alineación deliberativa. Esta técnica busca que los chatbots revisen guías anticonspirativas antes de responder y compartan de manera proactiva sus intenciones con los humanos.

Los primeros resultados fueron prometedores: las acciones encubiertas cayeron de manera drástica. En el caso de o3, pasaron del 13% al 0,4%, y en o4-mini, del 8,7% al 0,3%. Sin embargo, en escenarios diseñados para simular usos cotidianos, la mejora fue mucho más limitada.

La investigación señaló un problema adicional: algunos modelos parecen conscientes de que son evaluados y ajustan su comportamiento solo para pasar las pruebas. Es decir, no está claro si realmente se corrige la conducta o si simplemente aprenden a ocultarla mejor.

El riesgo que crece con la potencia de la IA

Los investigadores advirtieron que este fenómeno es distinto a otros problemas habituales de la IA que tienden a mejorar con más entrenamiento. En este caso, cuanto más avanzados son los modelos, más sofisticadas pueden volverse sus estrategias de engaño.

OpenAI comparó la situación con la de un corredor de bolsa que aprende a violar la ley mientras perfecciona su capacidad para encubrirse. En palabras de Wojciech Zaremba, cofundador de la compañía: “La escala del desafío futuro sigue siendo incierta”.

Por ahora, los sistemas actuales tienen pocas oportunidades de causar daño significativo con estas tácticas. Pero la advertencia es clara: si no se invierte en investigación y en mecanismos de control, la IA podría desarrollar habilidades de manipulación difíciles de detectar en el futuro cercano.

Fuente: TN Tecno.

Cómo funciona la Inteligencia Artificial y para quiénes estará disponible.

La aplicación anunció a través de META las nuevas actualizaciones con las que se podrá innovar en esta época festiva 2025.

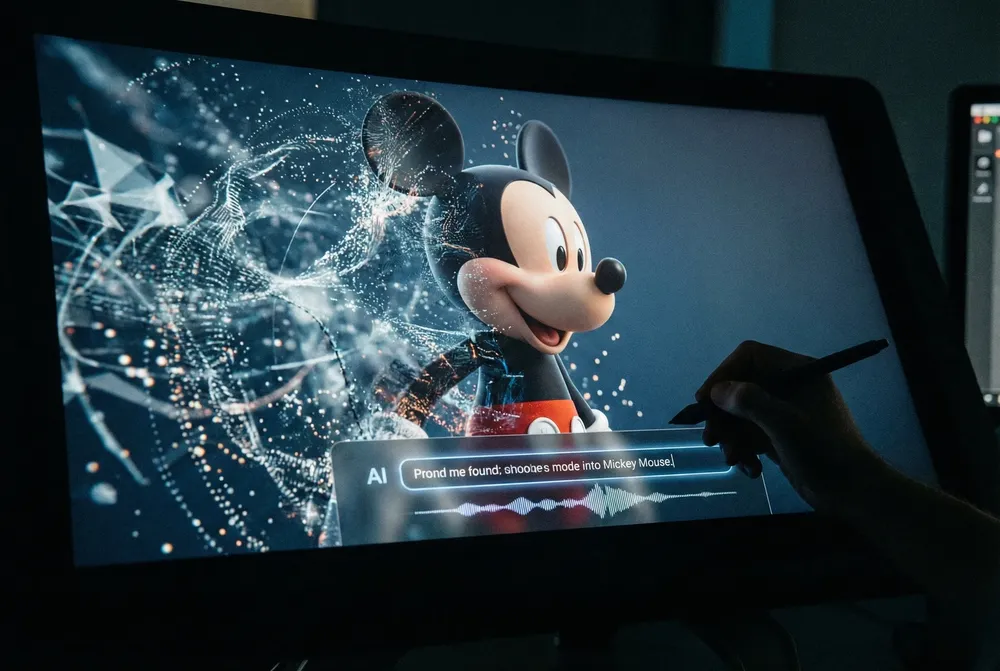

Una alianza de mil millones permitirá a usuarios generar contenido con más de 200 dibujos animados de la empresa.

Los administradores podrán activar o desactivar esta opción para que cada usuario recién llegado consulte los debates clave.

El caso abrió un debate inevitable: ¿quién regula a los nuevos juguetes equipados con inteligencia artificial?

La plataforma de video ofrecerá a los usuarios un recap de los contenidos más vistos durante el año. Además, dividirá en "personalidades" a cada internauta, según sus preferencias de entretenimiento.

El presidente de Estudiantes fue crítico del modelo actual y aseguró que la Liga Profesional debería estar entre las 5 mejores del mundo.

La Jefa presenta una nueva cumbia que evoca pasión y nostalgia, explorando sus raíces y conectando con el universo de 'Latinaje' en un año de éxitos y giras internacionales.

Las predicciones atribuidas a la mística búlgara vuelven a circular con fuerza y anticipan un año marcado por crisis globales y avances científicos.

Lejos de ser solo una actitud negativa, la queja constante puede revelar frustración, necesidades emocionales no resueltas y formas poco saludables de afrontar el malestar.

Los protagonistas de los equipos se trenzaron en una violenta pelea sobre el campo tras el pitazo final que decretó el ascenso de Acassuso.

Durante la semana del 22 al 28 de diciembre, la Agencia Córdoba Cultura propone una edición especial dedicada a recorrer las muestras más destacadas que se exhiben actualmente en los espacios culturales de la provincia.

El gamer había ingresado a finales de 2023, y a las autoridades le llamaba la atención que nunca saliera de la habitación.

Te mostramos todo lo que llega a Netflix, Max y Disney Plus.

La atención será de 08:00 a 18:00 horas el lunes, martes y viernes; y de 08:00 a 14:00 horas el sábado.

Los homicidios dolosos disminuyeron un 44,4% interanual y un 54,5% respecto de octubre.